知識工作可以自動化?

一個月沒更新電子報,近況更新:換工作了,好忙!

在一間線上課程新創研究AI,從自己用AI工具,到開發工具給同事用,不再是自己用得爽就好,還需要有平台化、規模化的思維,例如要管控風險、做好備援機制,上線後的專案,AI修改前我一律請他一並把風險列出來評估,將意外機率降到最低。

久違火力全開工作,腦袋偶爾還是會轉不過來,不僅要識別各部門流程痛點,用AI自動化,身上還要背專案,看看這20天我做了什麼:

人資系統CLI

一頁式銷售網頁管理平台

搜集老闆偏好的編輯器

utm、sms平台API

自動進線上會議錄音、摘要、螢幕錄影並存到notion的bot

Line bot管理平台

五個Skills

新課程研究、提案

AI帶來的生產力,真的有點瘋狂。

以下正文:

難道只有我夢想著一覺醒來,工作就完成了的生活嗎?不可能吧。

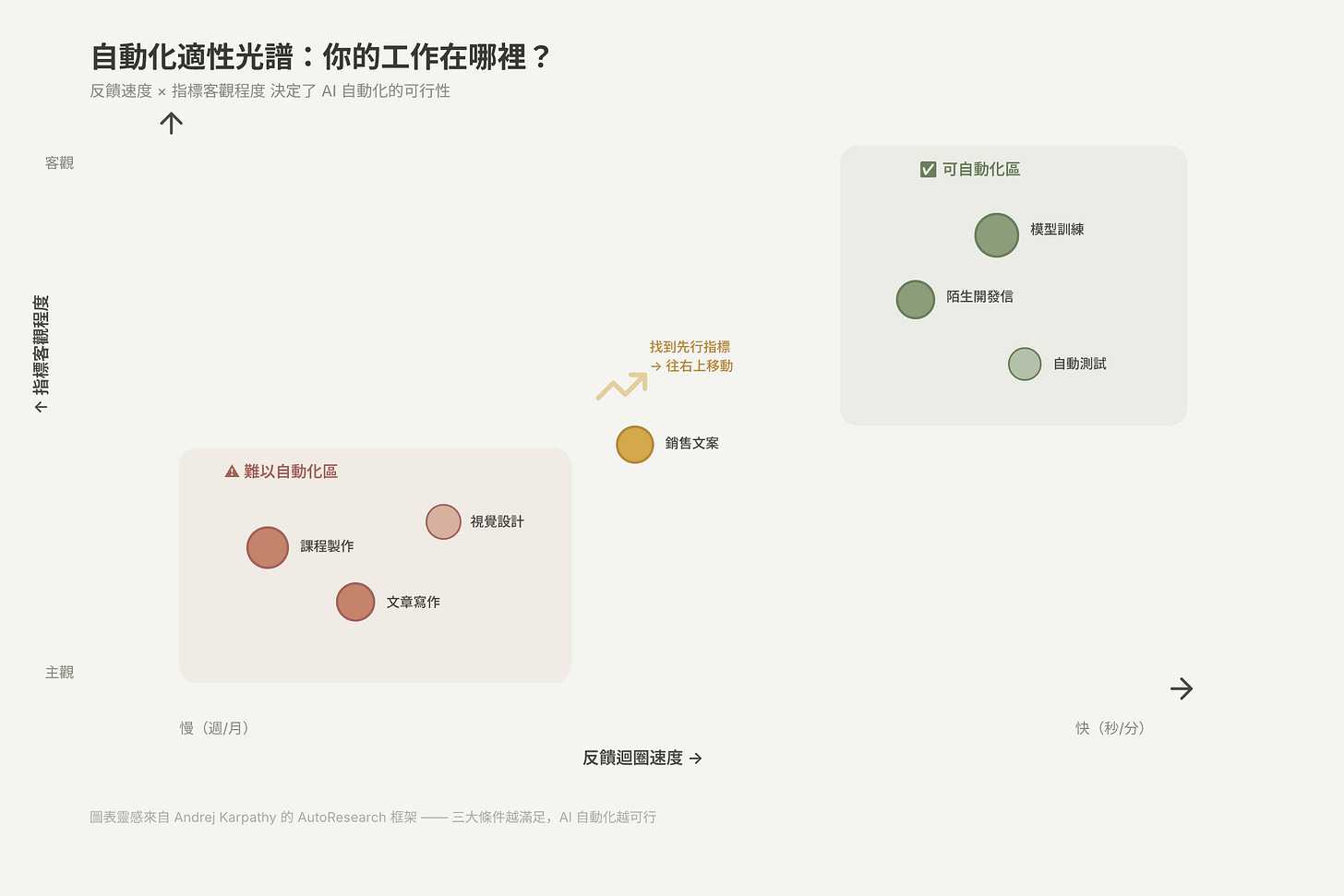

這樣的夢幻系統已經被前 OpenAI 及Tesla 核心成員 Andrej Karpathy 設計出來了,他設計出 AutoResearch 框架,透過自動修改程式碼(或微調超參數),接著進行 5 分鐘的模型訓練,訓練完成後檢查指標,進行下一次的迭代,讓 AI 能24小時自主訓練模型。

聽起來令人興奮,但問題是我所在的知識產業,似乎是最不適合自動化系統的產業之一。

知識產業依賴主觀指標衡量結果,我之前嘗試 AI 寫長文時,因為指標主觀、模糊,所以難以測試,也因此無法將我的標準移植到 AI 上,產出的內容難以符合需求。我想到最好的策略就是「以量達質」,讓 AI 一次生成多篇草稿,再由人類評斷。美其名是 Human in the loop ,但此機制仍舊無法達成真正的自動化,人類瓶頸依然存在,無法讓 AI 自行進化產生最終成品。

延伸閱讀:AI 寫長文實驗

Andrej Karpathy 系統成功的三大先決條件:

1. 反饋迴圈要夠短:實驗必須能在幾分鐘或幾小時內獲得數據,這個循環速度決定了 AI 進化的效率。

2. 客觀的衡量指標:AI必須依據量化的數據迭代,例如流量、點擊率,而不是主觀的感受。這對一些文章或是課程品質來說都很困難,因為這常常都是「感覺」主導,老闆會用他的經驗與直覺來判斷說這個會不會「中」,經驗累積產生的直覺,很難複製。

3. 是否有API 實現閉環:包含取得數據的 API、上架內容的 API,這樣子系統才可以用程式來直接修改輸入端,否則 AI 只能給出建議,無法自主執行任務

自動化專家Nick Saraev,專門將各種自動化工具打造成可銷售的系統。他擅長陌生開發自動化,能在短時間內打造最高回覆率的陌生開發信。他將這套系統從自主訓練模型延伸到商業領域,用回覆率當指標,自主迭代陌生開發信的品質。

這給了我靈感,這種做法也能用在課程流程與文章上。由於文章或課程獲得反饋的速度太慢,例如一門課動輒三個月、半年製作期,完成後才上市看銷量,實在太久,不符合快速驗證條件。

因此,我們必須從先行指標下手。例如做課的關鍵步驟之一是撰寫課程論述,然而誰來判斷論述好壞?許多狀況下是老闆一人決定。若能將課程論述切角拆分成多則landing page,透過廣告投放,依據點擊率、轉換率快速判斷消費者對主題與論述的興趣,再讓 AI 收集數據、分析文案優劣並進一步優化,是否更有機會實現知識產業自動化?

再往前想一步,生產力的瓶頸始終是人類,我們要睡、要吃,容易分心還愛抱怨,但當我們不曾掙扎過,還能懂人性嗎,沒經歷過改稿地獄,不用改稿時會真的開心嗎?

如果人類不需被要求要有生產力,如果我們真的不用以工作換取金錢,也許有機會奪回那份被金錢獎勵所消弭熱情——做一件有趣的事的純粹。